- o3推論モデルは複雑なロジック設計・アルゴリズム実装でGPT-5.4を大幅に上回る精度

- Codex CLIの--modelフラグで簡単にo3に切り替え可能

- コスト効率を考慮したo3/GPT-5.4の使い分け戦略が現場で重要

「Codex CLIでもっと正確なコード生成をしたい」「o3モデルって何が違うの?」「推論モデルの使いどころがわからない」

OpenAI Codex CLIでo3推論モデルを活用することで、従来のGPT-5.4では困難だった高度なアルゴリズム設計やアーキテクチャ決定を、AIにサポートさせることが可能になります。 o3は「考えてから答える」推論プロセスにより、複雑な論理的タスクで圧倒的な精度を実現します。

この記事では、Codex CLI完全攻略シリーズEp.54として、o3推論モデルの特性と実践的な活用方法を徹底解説します。

- o3推論モデルの特性とGPT-5.4との違い

- Codex CLIでのo3の設定方法と使い方

- 推論モデルが威力を発揮するユースケース

- コスト効率を考慮した使い分け戦略

o3推論モデルとは?通常モデルとの本質的な違い

推論モデルの基本アーキテクチャ

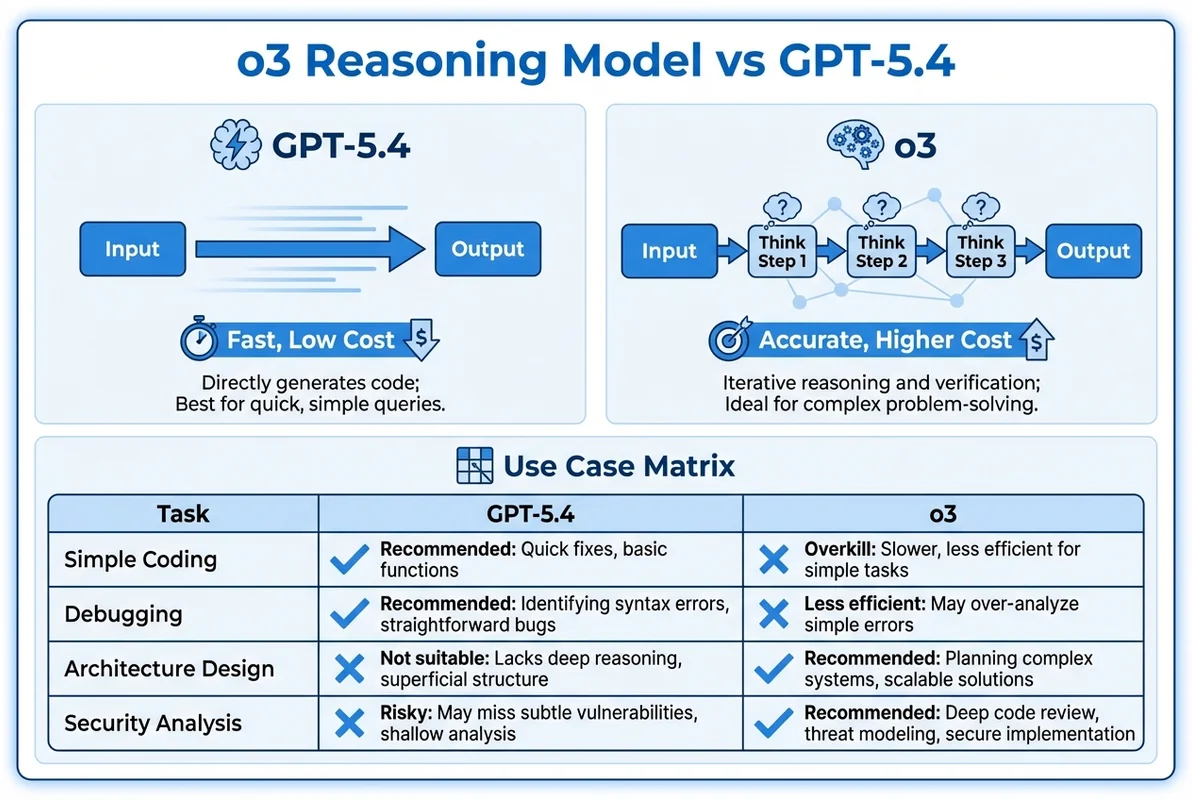

o3は、OpenAIが開発した推論特化型モデルです。通常のGPTシリーズが「テキスト→即座に応答」するのに対し、o3は内部でChain of Thought(思考連鎖)推論プロセスを実行してから回答を生成します。

通常モデル(GPT-5.4):

入力 → [即座に生成] → 出力

推論モデル(o3):

入力 → [思考ステップ1] → [思考ステップ2] → ... → [思考ステップN] → 出力この「考える時間」により、以下の能力が大幅に向上します:

- 論理的推論 — 条件分岐が複雑なロジックの正確な実装

- 数学的計算 — アルゴリズムの計算量分析、最適化

- 多段階プランニング — 大規模リファクタリングの手順設計

- バグの根本原因分析 — 複雑なバグのデバッグ

o3シリーズのモデルラインナップ

| モデル | 推論能力 | 速度 | コスト | 推奨用途 |

|---|---|---|---|---|

o3 | ⭐⭐⭐⭐⭐ | 遅い | 高い | 複雑なアーキテクチャ設計 |

o3-mini | ⭐⭐⭐⭐ | 中程度 | 中程度 | アルゴリズム実装 |

o4-mini | ⭐⭐⭐⭐ | 中程度 | 中程度 | コードレビュー・デバッグ |

GPT-5.4 | ⭐⭐⭐ | 速い | 低い | 一般的なコーディング |

Codex CLIでのo3設定方法

基本的な使い方

# o3モデルを指定してCodex CLIを起動

codex --model o3 "このアルゴリズムを最適化して"

# o3-miniで起動(コストを抑えつつ推論能力を活用)

codex --model o3-mini "バグの原因を分析して"

# 一時的なモデル切り替え

codex --model o3 --print "データベーススキーマの設計案を3つ提案して"設定ファイルでのデフォルトモデル変更

// ~/.codex/config.json

{

"model": "o3-mini",

"fallback_model": "gpt-5.4",

"reasoning_effort": "medium",

"max_tokens": 16384

}reasoning_effortパラメータ

o3シリーズでは、推論の深さをreasoning_effortパラメータで制御できます。

# 軽い推論(速度重視)

codex --model o3-mini --reasoning-effort low "変数名を改善して"

# 標準推論(バランス型)

codex --model o3-mini --reasoning-effort medium "このバグを修正して"

# 深い推論(精度重視)

codex --model o3 --reasoning-effort high "セキュリティ脆弱性を分析して"| reasoning_effort | 推論時間 | 精度 | コスト | 用途 |

|---|---|---|---|---|

low | 数秒 | 良好 | 低 | 単純な改善・リネーム |

medium | 10-30秒 | 高い | 中 | バグ修正・リファクタリング |

high | 30秒-2分 | 最高 | 高 | 設計判断・脆弱性分析 |

o3が威力を発揮するユースケース

ユースケース1: 複雑なアルゴリズム実装

o3は、動的計画法やグラフアルゴリズムなど、論理的思考が必要なアルゴリズムの実装で真価を発揮します。

# GPT-5.4では正確に実装できないことがあるタスク

codex --model o3 "

与えられた有向グラフで、全頂点を訪問する最短ハミルトンパスの近似解を求める

アルゴリズムを実装してください。

要件:

- TypeScriptで実装

- 頂点数が1000以上でも実用的な速度

- 近似率の理論的保証を持つアルゴリズムを選択

- 計算量をコメントで記載

"o3は以下のように推論します:

- 問題の NP 困難性を認識

- 近似アルゴリズムの候補を列挙(Christofides、貪欲法、2-opt)

- 要件に最も合致するアルゴリズムを選択

- 実装の詳細を設計してからコードを生成

ユースケース2: アーキテクチャ決定支援

マイクロサービスのサービス分割やデータフローの設計など、多くの要因を考慮する必要がある設計判断にo3を活用します。

codex --model o3 --reasoning-effort high "

現在のモノリスアプリケーション(Eコマースサイト)をマイクロサービスに

分割する計画を立ててください。

現在のモジュール:

- ユーザー管理(認証・認可含む)

- 商品カタログ

- 在庫管理

- 注文処理

- 決済処理

- 配送管理

- レビュー・評価

- 通知(メール・プッシュ)

考慮事項:

- チーム規模: 15人

- 段階的移行(ビッグバンリリースは避ける)

- データ整合性の担保方法

- サービス間通信の方式選択

"ユースケース3: 高精度コードレビュー

o3の推論能力は、セキュリティ脆弱性の検出やレースコンディションの発見で、通常モデルを大きく上回ります。

codex --model o3 --print "

以下のコードのセキュリティレビューを行ってください。

特に以下の観点で分析してください:

1. SQLインジェクション

2. XSS(クロスサイトスクリプティング)

3. 認証・認可の不備

4. レースコンディション

5. 情報漏洩

ファイル: src/controllers/userController.ts

"ユースケース4: 複雑なデバッグ

再現困難なバグや、複数コンポーネントにまたがる問題の分析にo3を活用します。

codex --model o3 --reasoning-effort high "

本番環境で断続的に発生している問題を調査してください。

症状:

- 1日に2-3回、ユーザーのセッションが突然切れる

- 特定の操作パターンに紐づいていない模様

- メモリ使用量は正常範囲

- CPUスパイクは発生していない

- Redisのログにはconnection resetが記録されている

関連するコード: src/middleware/session.ts, src/lib/redis.ts, src/config/cache.ts

"o3とGPT-5.4の使い分け戦略

コスト比較

タスク: 100行のTypeScriptファイルのリファクタリング

GPT-5.4:

- 入力トークン: ~2,000 ($0.003)

- 出力トークン: ~3,000 ($0.009)

- 合計: ~$0.012

- 処理時間: 5-10秒

o3-mini:

- 入力トークン: ~2,000 ($0.004)

- 推論トークン: ~5,000 ($0.025)

- 出力トークン: ~3,000 ($0.015)

- 合計: ~$0.044

- 処理時間: 15-30秒

o3:

- 入力トークン: ~2,000 ($0.008)

- 推論トークン: ~10,000 ($0.080)

- 出力トークン: ~3,000 ($0.030)

- 合計: ~$0.118

- 処理時間: 30-60秒使い分けフローチャート

タスクの複雑さは?

├─ シンプル(リネーム、フォーマット)→ GPT-5.4

├─ 中程度(バグ修正、機能追加)→ GPT-5.4 または o3-mini

├─ 複雑(アルゴリズム、設計判断)→ o3-mini

└─ 非常に複雑(セキュリティ分析、アーキテクチャ)→ o3 (high effort)自動モデル切り替えスクリプト

タスクの内容に応じて自動的にモデルを切り替えるスクリプトを作成することも可能です。

#!/bin/bash

# smart-codex.sh - タスクに応じたモデル自動選択

TASK="$1"

# キーワードベースのモデル選択

if echo "$TASK" | grep -qiE "security|vulnerability|exploit|injection"; then

MODEL="o3"

EFFORT="high"

elif echo "$TASK" | grep -qiE "algorithm|architecture|design|migrate"; then

MODEL="o3-mini"

EFFORT="medium"

elif echo "$TASK" | grep -qiE "debug|bug|error|fix"; then

MODEL="o3-mini"

EFFORT="low"

else

MODEL="gpt-5.4"

EFFORT=""

fi

echo "🤖 Selected model: $MODEL (effort: ${EFFORT:-N/A})"

if [ -n "$EFFORT" ]; then

codex --model "$MODEL" --reasoning-effort "$EFFORT" "$TASK"

else

codex --model "$MODEL" "$TASK"

fi実践: o3でのプロジェクト分析ワークフロー

ステップ1: プロジェクト全体の分析

# プロジェクト構造の分析と改善提案

codex --model o3 --reasoning-effort medium "

このプロジェクトの構造を分析して、以下を報告してください:

1. アーキテクチャの強みと弱み

2. 技術的負債のホットスポット

3. テストカバレッジの改善が最も効果的な箇所

4. パフォーマンスボトルネックの可能性

5. 優先的に対処すべき改善項目(影響度×工数のマトリクス)

"ステップ2: 個別課題の深掘り

# 特定の問題の根本原因分析

codex --model o3 --reasoning-effort high "

src/services/orderService.tsの processOrder関数で、

高負荷時にデッドロックが発生する可能性を分析してください。

関連するデータベーストランザクションとロック戦略を

すべて洗い出して、改善案を提示してください。

"ステップ3: 改善の実装

# 分析結果に基づく改善の実装

codex --model o3-mini "

先ほどの分析に基づいて、orderService.tsのデッドロック問題を修正してください。

楽観的ロックパターンを導入し、リトライロジックを追加してください。

テストコードも作成してください。

"CI/CDでのo3活用

PRレビューでのモデル使い分け

# .github/workflows/ai-review.yml

name: AI PR Review

on:

pull_request:

types: [opened, synchronize]

jobs:

quick-review:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v4

- name: Quick Review (GPT-5.4)

run: |

codex --model gpt-5.4 --print \

"変更されたファイルのスタイルとフォーマットをチェックして"

deep-review:

runs-on: ubuntu-latest

if: contains(github.event.pull_request.labels.*.name, 'needs-deep-review')

steps:

- uses: actions/checkout@v4

- name: Deep Review (o3)

run: |

codex --model o3 --reasoning-effort high --print \

"このPRのセキュリティ脆弱性、レースコンディション、

エッジケースの未処理を網羅的に分析して"週次コード品質レポート

#!/bin/bash

# weekly-quality-report.sh

codex --model o3 --reasoning-effort medium --print "

このリポジトリの過去1週間の変更を分析して、

コード品質レポートを作成してください。

含めるべき項目:

1. 新たに導入された技術的負債

2. 改善されたコード品質

3. テストカバレッジの変化

4. セキュリティ上の注意点

5. 来週の推奨アクション

" > reports/weekly-quality-$(date +%Y%m%d).mdパフォーマンス最適化のTips

推論トークンの節約

# 良い例: コンテキストを絞って質問

codex --model o3 "src/utils/parser.tsの parseJSON関数にある

型安全性の問題を修正して"

# 悪い例: 広すぎるコンテキスト(推論トークンが爆発)

codex --model o3 "プロジェクト全体のすべての型安全性の問題を

見つけて修正して"ストリーミング出力の活用

# ストリーミングモードでリアルタイムに結果を確認

codex --model o3 --stream "

このAPIエンドポイントのパフォーマンス問題を分析して。

分析しながらリアルタイムに結果を出力して"キャッシュの活用

同じコンテキストで複数の質問をする場合、セッション内で連続して質問することで、コンテキストのキャッシュが効きます。

# セッションモードで起動(コンテキストが継続)

codex --model o3-mini

# セッション内で連続質問

> このプロジェクトの構造を分析して

> さっき見つけた問題のうち、最も優先度が高いものを修正して

> 修正のテストを書いてまとめ: o3推論モデルで開発品質を次のレベルへ

o3推論モデルは、Codex CLIの可能性を大きく広げるツールです。すべてのタスクにo3を使う必要はありませんが、適切なユースケースで活用することで、コードの品質と開発効率を飛躍的に向上させることができます。

o3を使うべき場面:

- 複雑なアルゴリズムの設計・実装

- アーキテクチャの意思決定

- セキュリティ脆弱性の分析

- 難解なバグのデバッグ

GPT-5.4で十分な場面:

- 一般的なCRUD操作の実装

- コードフォーマット・リネーム

- ドキュメント生成

- 簡単なテスト作成

コスト効率を意識しながら、タスクの複雑さに応じてモデルを使い分けることが、SES現場で求められるスキルです。

- 推論モデルの活用経験は、AI駆動開発の最前線スキルとして評価される

- 「複雑な問題をAIと協働で解決した経験」は面談で大きな武器になる

- コスト管理の視点を持つことで、チームリーダーとしての信頼を獲得できる