- SageMakerはデータ準備→モデル構築→デプロイまでをフルマネージドで提供するML基盤

- ML案件の単価相場は80万〜130万円/月、AWS認定ML Engineer取得で差別化可能

- MLOpsパイプライン構築経験があればエンタープライズ案件にも参入できる

「機械学習案件に興味があるけど、何から始めればいいかわからない」「SageMakerの名前は知っているけど、実務でどう使うの?」——そんなSESエンジニアの方に向けた実践入門ガイドです。

結論から言うと、AWS SageMakerはSESエンジニアがML案件にステップアップするための最適なプラットフォームです。AWSの既存知識を活かしつつ、機械学習のスキルを段階的に習得できます。

この記事はAWS完全攻略シリーズのEp.15として、SageMakerの基本ワークフローからSES案件で求められるスキルまでを体系的に解説します。

- SageMakerの主要機能とML開発における位置づけ

- データ準備→モデル構築→デプロイの基本ワークフロー

- SageMaker Studioの効率的な活用方法

- SES案件で求められるMLスキルと単価相場

AWS SageMakerとは?SESエンジニアが学ぶべき理由

SageMakerの主要機能と位置づけ

AWS SageMakerは、機械学習のライフサイクル全体をカバーするフルマネージドサービスです。データの前処理からモデルの構築・トレーニング・デプロイ・監視まで、一つのプラットフォームで完結します。

SageMakerの主要コンポーネント:

| コンポーネント | 役割 | 主な用途 |

|---|---|---|

| SageMaker Studio | 統合開発環境 | ノートブック開発・実験管理 |

| SageMaker Training | モデルトレーニング | 分散学習・ハイパーパラメータチューニング |

| SageMaker Endpoints | モデルデプロイ | リアルタイム推論・バッチ推論 |

| SageMaker Pipelines | MLOpsパイプライン | 自動化・CI/CD |

| Feature Store | 特徴量管理 | データの一元管理・再利用 |

| Model Registry | モデル管理 | バージョン管理・承認フロー |

| Model Monitor | モデル監視 | ドリフト検知・品質監視 |

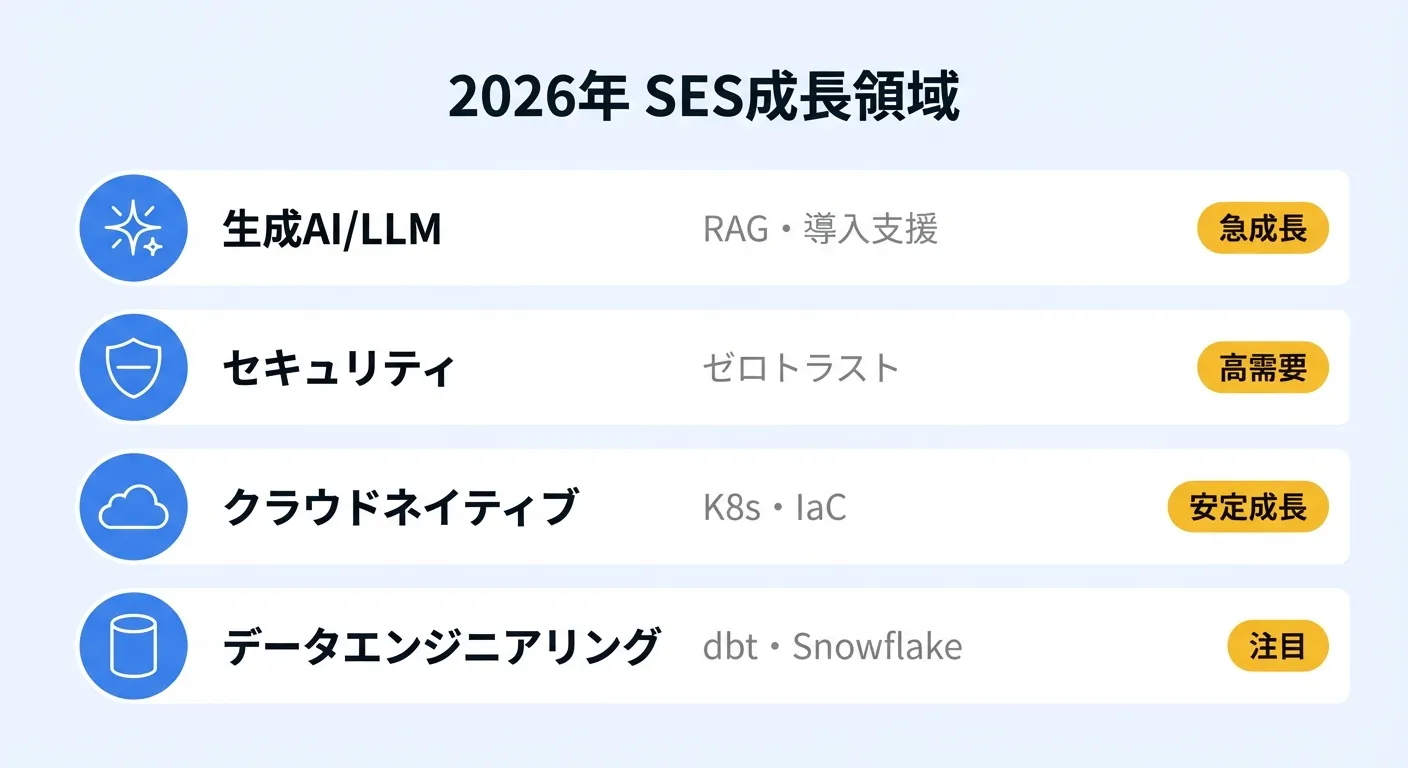

ML案件の需要急増とSES市場への影響

2026年のSES市場では、ML/AI関連案件の需要が急速に拡大しています。SES×生成AI案件の単価相場でも触れていますが、特にAWS上でのML基盤構築案件は増加の一途をたどっています。

ML案件が増えている背景:

- 企業のDX推進: データ活用が経営課題の上位に

- SageMakerの進化: ノーコード/ローコード機能で参入障壁が低下

- AWSスキルの汎用性: 既存のAWSスキルをML領域に拡張しやすい

AWS SESエンジニアガイドで紹介しているAWSの基礎スキルがあれば、SageMakerの学習はスムーズに進められます。

SageMakerの基本ワークフロー

データ準備(S3連携・Feature Store)

機械学習プロジェクトの成否を決めるのはデータの品質です。SageMakerでは、S3をデータレイクとして活用し、Feature Storeでデータを管理します。

ステップ1:データをS3にアップロード

import boto3

s3 = boto3.client('s3')

s3.upload_file('training_data.csv', 'my-ml-bucket', 'data/training.csv')ステップ2:Feature Storeで特徴量を管理

from sagemaker.feature_store.feature_group import FeatureGroup

feature_group = FeatureGroup(

name='customer-features',

sagemaker_session=sagemaker_session,

feature_definitions=[

FeatureDefinition(feature_name='customer_id', feature_type=FeatureTypeEnum.STRING),

FeatureDefinition(feature_name='purchase_count', feature_type=FeatureTypeEnum.INTEGRAL),

FeatureDefinition(feature_name='avg_order_value', feature_type=FeatureTypeEnum.FRACTIONAL),

]

)Feature Storeを使うことで、チーム間でデータを共有し、再利用性を高めることができます。

モデル構築とトレーニング(ビルトインアルゴリズム)

SageMakerには、ビルトインアルゴリズムが多数用意されており、独自のモデルをゼロから構築する必要がありません。

代表的なビルトインアルゴリズム:

| アルゴリズム | 用途 | 典型的なユースケース |

|---|---|---|

| XGBoost | 分類・回帰 | 需要予測、チャーン予測 |

| BlazingText | テキスト分類 | 感情分析、カテゴリ分類 |

| Image Classification | 画像分類 | 製品検品、顔認識 |

| DeepAR | 時系列予測 | 売上予測、在庫最適化 |

| K-Means | クラスタリング | 顧客セグメンテーション |

トレーニングの実行例:

from sagemaker.estimator import Estimator

estimator = Estimator(

image_uri=sagemaker.image_uris.retrieve('xgboost', region, version='1.7-1'),

role=role,

instance_count=1,

instance_type='ml.m5.xlarge',

output_path=f's3://{bucket}/output',

hyperparameters={

'max_depth': 5,

'eta': 0.2,

'objective': 'binary:logistic',

'num_round': 100,

}

)

estimator.fit({'train': train_data, 'validation': val_data})デプロイとエンドポイント管理

トレーニングしたモデルをデプロイして、APIとして利用可能にします。

# リアルタイム推論エンドポイントのデプロイ

predictor = estimator.deploy(

initial_instance_count=1,

instance_type='ml.m5.large',

endpoint_name='churn-prediction-endpoint'

)

# 推論の実行

result = predictor.predict(test_data)デプロイオプションは3種類あります。

| デプロイ方式 | レイテンシ | コスト | 用途 |

|---|---|---|---|

| リアルタイム | 〜100ms | 常時稼働 | APIとして常時利用 |

| サーバーレス | 〜1s | リクエスト単位 | 低頻度のリクエスト |

| バッチ変換 | 分〜時間 | ジョブ単位 | 大量データの一括処理 |

AWS Lambda サーバーレスと連携すれば、コスト効率の良い推論パイプラインを構築できます。

SageMaker Studio活用ガイド

ノートブック環境のセットアップ

SageMaker Studioは、JupyterLabベースの統合ML開発環境です。ブラウザ上でノートブックの作成、モデルのトレーニング、結果の可視化が完結します。

セットアップ手順:

- SageMakerコンソールで「Studio」を選択

- ドメインとユーザープロファイルを作成

- JupyterLab Spaceを起動

- カーネル(Python 3.10 + PyTorch / TensorFlow)を選択

Experiments & Trialsでの実験管理

機械学習では、ハイパーパラメータの異なる多数の実験を管理する必要があります。SageMaker Experimentsを使えば、各実験の設定・メトリクス・成果物を自動的に記録できます。

from sagemaker.experiments import Run

with Run(experiment_name='churn-prediction', run_name='xgboost-v1') as run:

run.log_parameter('max_depth', 5)

run.log_parameter('learning_rate', 0.2)

# トレーニング実行

estimator.fit(...)

run.log_metric('accuracy', 0.92)

run.log_metric('f1_score', 0.88)Model Registryでのバージョン管理

Model Registryは、トレーニング済みモデルのバージョン管理と承認フローを提供します。

from sagemaker.model import ModelPackage

model_package = ModelPackage(

model_package_group_name='churn-prediction-models',

model_data=estimator.model_data,

approval_status='PendingManualApproval'

)本番デプロイ前にチームリーダーの承認を必須にするワークフローを構築でき、SES案件でのガバナンス要件にも対応できます。

MLOpsパイプラインの構築

SageMaker Pipelinesの設計

SageMaker Pipelinesは、ML開発のCI/CDを実現するサービスです。データ前処理→トレーニング→評価→デプロイまでの一連の流れを自動化できます。

from sagemaker.workflow.pipeline import Pipeline

from sagemaker.workflow.steps import ProcessingStep, TrainingStep, CreateModelStep

pipeline = Pipeline(

name='churn-prediction-pipeline',

steps=[

preprocess_step, # データ前処理

training_step, # モデルトレーニング

evaluation_step, # モデル評価

condition_step, # 精度チェック(閾値以上ならデプロイ)

deploy_step, # エンドポイントデプロイ

]

)

pipeline.upsert(role_arn=role)

pipeline.start()Step Functions連携による自動化

より複雑なワークフローには、AWS Step Functionsとの連携が有効です。

- データ到着をEventBridgeで検知

- Step Functionsでパイプラインを起動

- 成功/失敗をSNSで通知

モデルモニタリングとドリフト検知

デプロイ後のモデルは、データドリフト(入力データの分布変化)やコンセプトドリフト(予測精度の低下)が発生する可能性があります。

from sagemaker.model_monitor import DataCaptureConfig

data_capture = DataCaptureConfig(

enable_capture=True,

sampling_percentage=20,

destination_s3_uri=f's3://{bucket}/data-capture'

)Model Monitorを設定することで、ドリフトを自動検知し、アラートを発信できます。AWS CloudWatch 監視と連携すれば、統合的な監視体制を構築できます。

SES案件で求められるスキルと単価相場

必須スキル(Python・AWS認定ML Engineer)

ML案件で最低限求められるスキルは以下の通りです。

- Python(中級以上): pandas、scikit-learn、NumPyの実務経験

- AWSの基礎: IAM、S3、EC2、VPCの運用経験

- SQL: データ抽出・前処理のためのSQLスキル

- 機械学習の基礎知識: 教師あり学習・教師なし学習・評価指標の理解

推奨資格:

- AWS Certified Machine Learning Engineer - Associate: ML案件の面談で強力なアピール材料

- AWS Certified Data Engineer - Associate: データパイプライン関連の案件にも有効

案件単価レンジ(80万〜130万円/月)

SageMaker関連のSES案件の単価相場は以下の通りです。

| スキルレベル | 単価レンジ | 主な業務内容 |

|---|---|---|

| ジュニア | 60万〜80万円 | データ前処理、ノートブック開発 |

| ミドル | 80万〜110万円 | モデル構築、API開発、パイプライン構築 |

| シニア | 110万〜130万円 | アーキテクチャ設計、MLOps、チームリード |

ポートフォリオの作り方

ML案件を獲得するためのポートフォリオの構成例です。

- Kaggleコンペの成績: 参加実績とアプローチの解説

- 個人プロジェクト: SageMakerで構築したMLパイプラインのGitHubリポジトリ

- 技術ブログ: 学習過程や実装のポイントを記事化

- AWS認定資格: ML関連の認定バッジ

SES S3 ストレージなどの基礎的なAWSスキルがあれば、SageMakerの学習にスムーズに移行できます。データの保存・取得の基本が理解できていることが前提です。

まとめ:SageMakerスキルでSES案件の選択肢を広げる

AWS SageMakerは、SESエンジニアがML領域にステップアップするための最適な入口です。

- 既存のAWSスキルを活かしてML開発に参入できる

- ビルトインアルゴリズムで機械学習の基礎を実践的に学べる

- MLOpsパイプラインの構築経験で高単価案件を狙える

- AWS認定資格で市場価値を客観的に証明できる

まずはSageMaker Studioでノートブック環境をセットアップし、ビルトインアルゴリズムでサンプルデータを使ったモデル構築を試してみてください。実際に手を動かすことで、ML開発の全体像がつかめるようになります。

参考: AWS公式ドキュメント「Amazon SageMaker Developer Guide」